Wann KI-Verbote sinnvoll sind – und wann sie reine Symbolpolitik bleiben

Dec 30, 2025

Kurzantwort

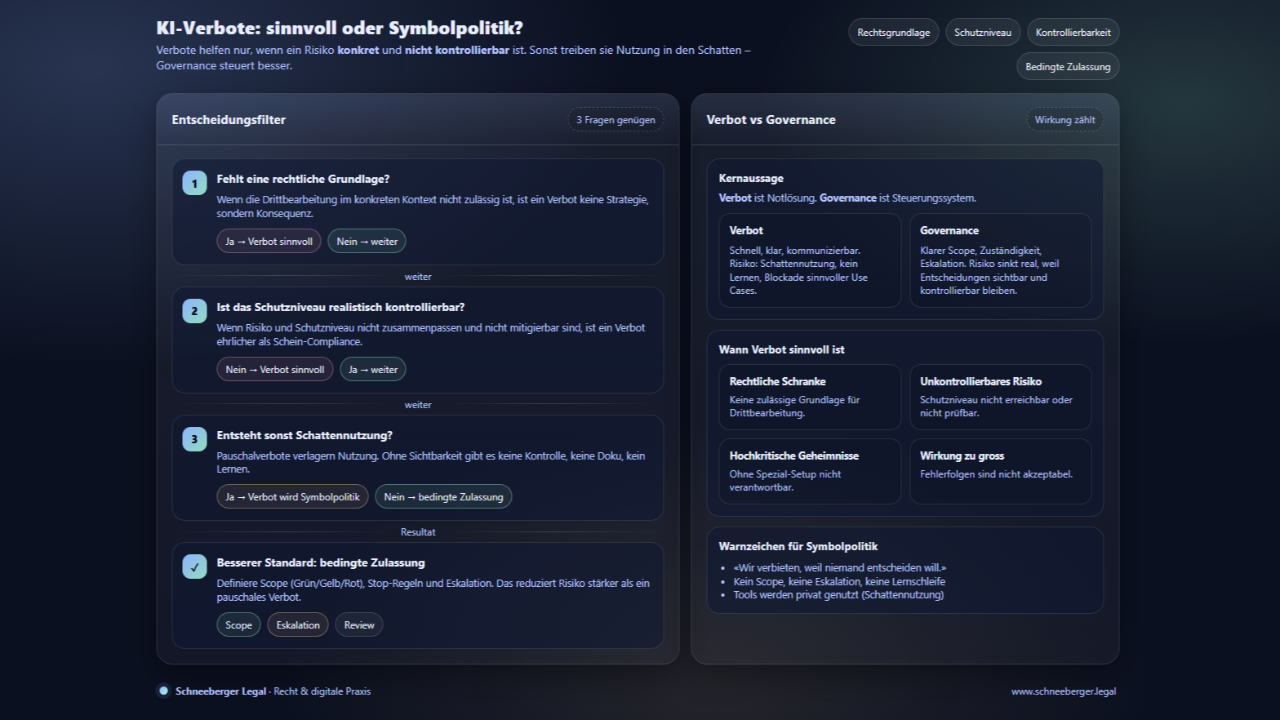

KI-Verbote sind nur dann sinnvoll, wenn sie ein konkretes, nicht kontrollierbares Risiko adressieren. In allen anderen Fällen ersetzen sie fehlende Governance durch Symbolik – und schaffen neue Probleme.

Warum KI-Verbote so attraktiv wirken

Wenn Unsicherheit steigt, greifen Organisationen zu einfachen Antworten.

Ein Verbot wirkt:

-

klar

-

schnell

-

kommunizierbar

-

entlastend für Entscheider

„Dann kann uns niemand vorwerfen, wir hätten nichts getan.“

Genau darin liegt das Problem.

Der Denkfehler hinter pauschalen KI-Verboten

Das implizite Argument lautet:

„Wenn wir KI verbieten, verschwindet das Risiko.“

Das ist falsch.

Ein Verbot:

-

verlagert Nutzung in den Schatten

-

entzieht Governance die Sicht

-

verhindert Lernen

-

erhöht faktisch das Risiko

Nicht weil KI gefährlich ist, sondern weil Realität nicht verschwindet, nur weil man sie verbietet.

Wann KI-Verbote tatsächlich sinnvoll sind

Es gibt Konstellationen, in denen ein Verbot richtig ist. Aber sie sind enger, als viele glauben.

1. Fehlende rechtliche Grundlage

Wenn:

-

keine zulässige Datenbearbeitung besteht

-

keine Drittbearbeitung erlaubt ist

-

gesetzliche Schranken klar greifen

Dann ist ein Verbot keine Strategie, sondern Rechtsfolge.

2. Unkontrollierbares Schutzniveau

Wenn:

-

Schutzanforderungen extrem hoch sind

-

technische oder organisatorische Kontrolle realistisch nicht möglich ist

-

Risiken nicht mitigierbar sind

Dann ist ein Verbot ehrlicher als Scheinlösungen.

3. Hochkritische Geheimniskonstellationen

Bei:

-

Amtsgeheimnissen

-

Berufsgeheimnissen

-

sicherheitsrelevanten Informationen

kann ein Verbot gerechtfertigt sein, wenn kein tragfähiges Spezial-Setup existiert.

Nicht wegen KI.

Sondern wegen der Konsequenzen eines Fehlers.

Wann KI-Verbote Symbolpolitik sind

In der Mehrzahl der Fälle erfüllen KI-Verbote eine andere Funktion.

1. Ersatz für fehlende Governance

Wenn niemand entscheiden will, wird verboten.

Das löst kein Problem, sondern:

-

verschiebt Verantwortung

-

blockiert sinnvolle Anwendungsfälle

-

fördert Wildwuchs ausserhalb offizieller Kanäle

2. Ersatz für Risikoanalyse

Verbote wirken schneller als saubere Abklärung.

Aber:

-

nicht jedes Risiko ist gleich

-

nicht jede Nutzung ist kritisch

-

nicht jedes Tool gleich gefährlich

Ohne Differenzierung ist ein Verbot intellektuell bequem, aber operativ schwach.

3. Beruhigung nach innen und aussen

Verbote signalisieren Kontrolle.

Intern wie extern.

Sie ersetzen jedoch keine:

-

Prozesse

-

Zuständigkeiten

-

Eskalationslogik

Das Risiko bleibt – nur unsichtbarer.

Die Alternative: Bedingte Zulassung statt Verbot

Reife Organisationen arbeiten nicht mit „Ja oder Nein“, sondern mit Bedingungen.

Typisch sind:

-

klar definierte No-go-Zonen

-

Freigabepflichten für Grenzfälle

-

technische und organisatorische Schutzmassnahmen

-

Eskalation statt Blockade

Das ist anspruchsvoller als ein Verbot – aber wirksam.

Praxisreflexion

In Organisationen mit pauschalen KI-Verboten passiert meist Folgendes:

-

Nutzung findet trotzdem statt

-

nur ohne Transparenz

-

ohne Dokumentation

-

ohne Lernschleife

In Organisationen mit klarer Governance:

-

wissen Mitarbeitende, was erlaubt ist

-

melden Grenzfälle

-

tragen Verantwortung

Der Unterschied ist nicht Mut, sondern Struktur.

Kurze Einordnung für die Praxis

-

KI-Verbote sind kein Zeichen von Reife

-

Sie sind manchmal notwendig, oft bequem

-

Governance reduziert Risiken besser als Verbote

-

Differenzierung schlägt Symbolik

Selbsttest

-

Ist das Verbot durch eine konkrete rechtliche Schranke begründet?

-

Oder ersetzt es fehlende Zuständigkeit?

-

Würde eine bedingte Zulassung mit klaren Regeln dasselbe Risiko besser steuern?

Wenn Frage 2 zutrifft, ist das Verbot kein Schutz – sondern ein Alibi.

Einordnung

KI-Verbote sind kein Governance-Instrument.

Sie sind eine Notlösung, wenn Governance fehlt oder versagt.

Wer KI verantwortungsvoll nutzen will, verbietet nicht reflexhaft –

sondern entscheidet bewusst.